Moderna företag och forskningsinstitut står inför exponentiell datatillväxt och allt mer komplexa AI-arbetsbelastningar.

• Traditionella serverlösningar når sina gränser – brottas med:

• Otillräcklig GPU-interconnect-bandbredd, vilket skapar flaskhalsar vid träning

• Termisk ineffektivitet under pågående arbetsbelastning

• Komplexa underhållscykler med långa driftstopp

• Inflexibla expanderingsvägar som hindrar skalbarhet

Aethlumis löser dessa hinder med en intelligent beräkningslösning från slut till slut, som omvandlar traditionella datacenter till högpresterande AI-infrastruktur.

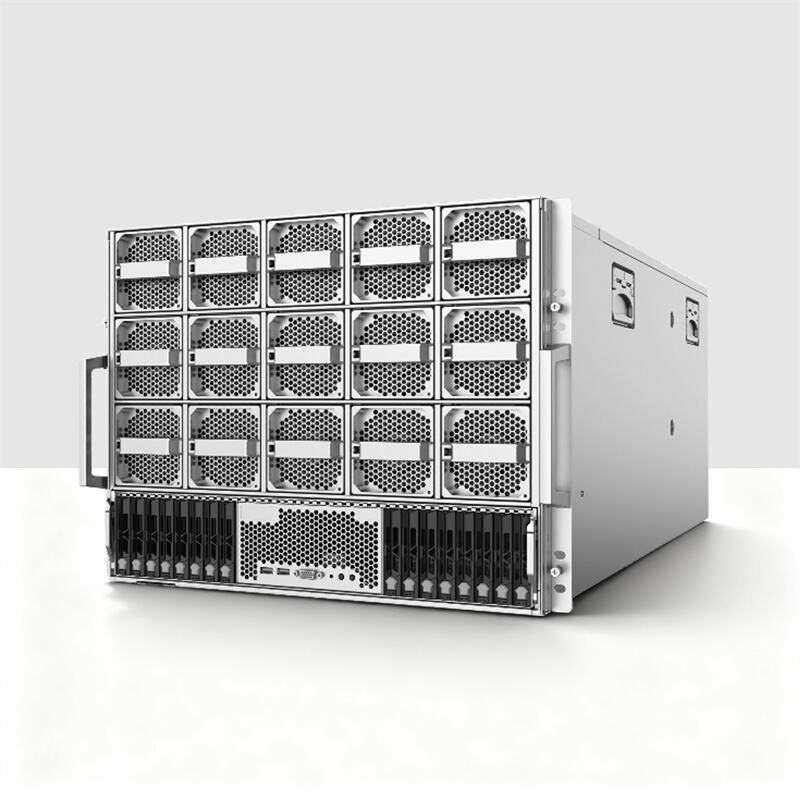

TG990V3 är Aethlumis nästa generations flaggskepps-server för artificiell intelligens, speciellt utvecklad för storskalig träning, inferens och dataintensiva arbetsbelastningar.

Den integrerar nyaste hårdvara, modulär arkitektur och intelligent hantering, och utgör kärnan i vår AI-infrastrukturstack.

Tekniska höjdpunkter

• Beräkningskraft: Dubbla 4:e / 5:e generationens Intel® Xeon® Scalable-processorer, TDP upp till 350 W

• GPU-förmåga: Stödjer upp till 8 OAM-GPU:er, fullt sammankopplade enligt OAI 2.0-standarden

• Expanderingsflexibilitet: Upp till 14 × PCIe 5.0-platser + valfritt OCP 3.0-gränssnitt

• Lagringsprestanda: Upp till 20 × 2,5 tum NVMe / SAS / SATA-enheter för högflödes I/O

• Effektivitetsgrad: Dubbelplansdesign (6 × 54 V GPU-zon + 2 × 12 V CPU-zon) eliminerar omvandlingsförluster

• Kylsystem: 15 fläktar med dubbla rotorer och zonstyrd kontroll, säkerställer stabil drift under full belastning av 8 GPU:er

• Smart hantering: BMC AST2600-chip som stöder IPMI 2.0, Redfish och SNMP för fullständig fjärrövervakning

Denna grund ger en balanserad topologisk arkitektur som stöder både högpresterande dubbla upplänkar och balanserade enkla upplänkar för att passa dina beräkningsklusterns krav.

Arkitekturlager:

• Beräkningslager — TG990V3 högdensitetsnoder med 8 OAM-GPU:er

• Nätverkslager — 8 × 400 G-interconnects som säkerställer skalförbundna kluster med extremt låg latens

• Lagringslager — Parallell lagring baserad på NVMe för snabb dataläsning

• Hanteringslager — Enhetlig Redfish/IPMI-plattform för dirigering, telemetri och felförekomstisolering

Denna modulära, avkopplade design möjliggör oberoende uppgraderingar, enkel underhåll och horisontell skalbarhet över rack eller datacenter.

Träning av AI-modeller

Designad för omfattande transformer-baserade arbetsbelastningar, vilket möjliggör träning av modeller med stora parametrar med minimal latens mellan GPU:er.

Stödjer GPUDirect RDMA och GDS för effektiv dataväg mellan GPU och lagring.

• Slutsatsdragning & Edge-AI

Flexibel GPU-konfiguration möjliggör accelererad slutsatsdragning för vision, NLP eller multimodal AI i stor skala.

Perfekt för AI-molntjänster och lokala edge-distributioner.

• Företagsdatabehandlingscentraler

Distribuera TG990V3 som ryggraden i din interna AI-plattform.

Enhetlig hantering minskar O&M-komplexitet och stödjer firmware-orchestration, loggsamling och smarta diagnostikverktyg.

• Moln- & HPC-kluster

Smidig 400 G skalningsförmåga för storskaliga datorfabriker — optimerad för flera klienter och hybrid-AI-moln.

| Kategori | Fördel | Påverkan |

| Prestandatäthet | Dubbla Xeon + 8 OAM GPU i 8U | Maximera beräkningskapacitet per rackenhet |

| Skalierbarhet | 14 × PCIe 5.0 platser, stöd för OCP 3.0 | Flexibel resursallokering |

| Underhållsbarhet | Bytbara modulära delsystem | Underhåll utan driftstopp |

| Hanterbarhet | Intelligent BMC med stöd för Redfish/IPMI | Fjärrstyrning och fellokalisation |

| Energieffektivitet | Design med dubbla strömsplan | Lägre effektförlust och värmeutveckling |

| Tillförlitlighet | Redundanta ström- och fläktmoduler | Tillgänglighet på företagsnivå |

Aethlumis erbjuder mer än bara hårdvara — vi levererar komplett integrering av AI-infrastruktur:

• Konsultation kring klusterdesign och distribution

• Optimering av nätverkstopologi

• Schemaläggning av GPU-resurser och containerisering (Kubernetes / Slurm)

• Design av värme- och strömfördelning

• Fjärrstyrningsträning och långsiktig support

Vårt ingenjörsteam arbetar tillsammans med era IT-arkitekter för att säkerställa att varje watt, byte och GPU-cykel är fullt optimerad för era AI-ambitioner.

Aethlumis samarbetar med ledande ekosystempartners inom beräkning, nätverk och lagring, inklusive: Intel®, NVIDIA®, Broadcom®, Mellanox® och Open Compute Project (OAI 2.0).

Detta säkerställer sömlös kompatibilitet och framtidsäkrad skalbarhet för er investering.

Aethlumis omdefinierar högprestandaberäkningar – levererar intelligenta, effektiva och skalbara lösningar för AI-eran.

Från forskningslabb till företagsdatacenter hjälper vi organisationer att omvandla beräkningskraft till innovation.