Les entreprises modernes et les institutions de recherche font face à une croissance exponentielle des données et à des charges de travail en intelligence artificielle de plus en plus complexes.

• Les systèmes serveurs conventionnels atteignent leurs limites — ils peinent face à :

• Une bande passante insuffisante des interconnexions GPU, créant des goulots d'étranglement lors de l'entraînement

• Une inefficacité thermique en cas de charges prolongées

• Des cycles de maintenance complexes entraînant de longues périodes d'indisponibilité

• Des chemins d'expansion inflexibles qui entravent l'évolutivité

Aethlumis surmonte ces obstacles grâce à une solution de calcul intelligent de bout en bout qui transforme les centres de données traditionnels en infrastructures IA hautes performances.

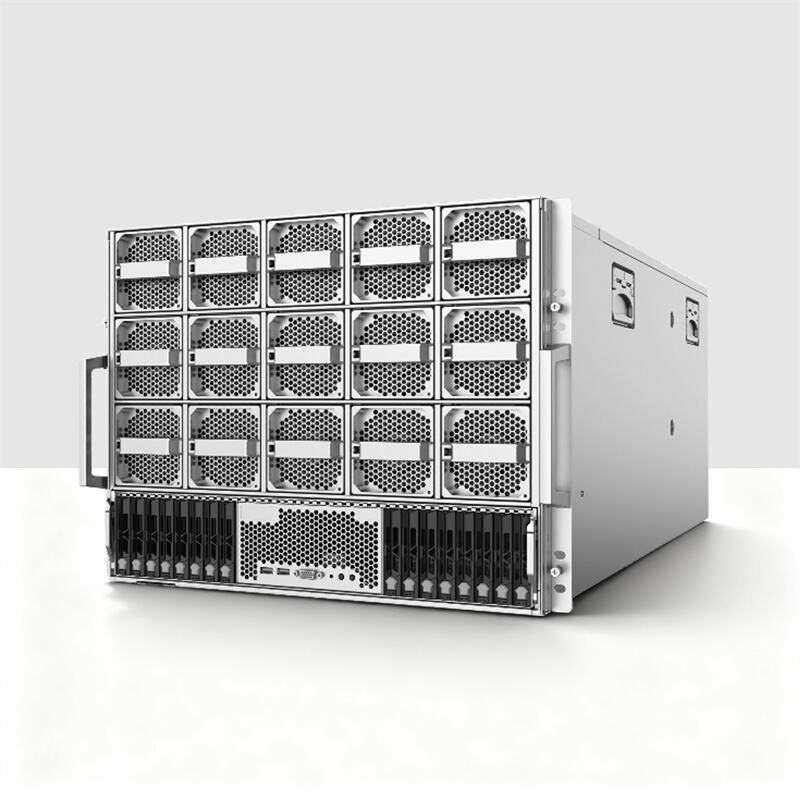

Le TG990V3 est le serveur phare de nouvelle génération d'Aethlumis, conçu spécifiquement pour l'entraînement à grande échelle, l'inférence et les charges de travail de données haute densité.

Il intègre un matériel de pointe, une architecture modulaire et une gestion intelligente, constituant ainsi le cœur de notre pile d'infrastructure IA.

Points techniques

• Puissance de calcul : Deux processeurs Intel® Xeon® Scalable de 4e / 5e génération, TDP allant jusqu'à 350 W

• Capacité GPU : Prend en charge jusqu'à 8 GPU OAM, entièrement interconnectés selon la norme OAI 2.0

• Flexibilité d'extension : Jusqu'à 14 emplacements PCIe 5.0 + interface OCP 3.0 en option

• Performance de stockage : Jusqu'à 20 disques NVMe / SAS / SATA de 2,5″ pour des entrées/sorties à haut débit

• Efficacité énergétique : Conception à double plan (zone GPU 6 × 54 V + zone CPU 2 × 12 V) éliminant les pertes de conversion

• Système de refroidissement : 15 ventilateurs à double rotor avec commande par zones, assurant un fonctionnement stable sous charge maximale de 8 GPU

• Gestion intelligente : Puce BMC AST2600 prenant en charge IPMI 2.0, Redfish et SNMP pour une surveillance à distance complète

Cette base permet une architecture de topologie équilibrée, prenant en charge à la fois les configurations Double liaison montante Hautes performances et Liaison montante unique équilibrée, adaptées aux besoins de votre cluster de calcul.

Couches d'architecture :

• Couche de calcul — Nœuds haute densité TG990V3 avec 8 GPU OAM

• Couche réseau — 8 interconnexions à 400 G assurant des grappes évolutives à latence ultra-faible

• Couche de stockage — Stockage parallèle basé sur NVMe pour un accès rapide aux données

• Couche de gestion — Plateforme unifiée Redfish/IPMI pour l'orchestration, la télémétrie et l'isolement des pannes

Cette conception modulaire et découplée permet des mises à niveau indépendantes, une maintenance facilitée et une évolutivité horizontale entre racks ou centres de données.

Entraînement du modèle d'intelligence artificielle

Conçu pour des charges de travail massives à l'échelle des transformateurs, permettant l'entraînement de modèles à grands paramètres avec une latence minimale entre les GPU.

Prend en charge GPUDirect RDMA et GDS pour un chemin de données efficace entre le GPU et le stockage.

• Inférence et IA embarquée

Une configuration GPU flexible permet d'accélérer l'inférence pour la vision, le TALN ou l'IA multimodale à grande échelle.

Idéal pour les services cloud d'IA et les déploiements locaux en périphérie.

• Centres de calcul d'entreprise

Déployez le TG990V3 comme pilier de votre plateforme IA interne.

La gestion unifiée réduit la complexité d'exploitation et prend en charge l'orchestration du micrologiciel, la collecte de journaux et les diagnostics intelligents.

• Cloud et grappes HPC

Capacité d'évolution transparente de 400 G pour les tissus de calcul à grande échelle — optimisée pour les environnements multi-locataires et les clouds hybrides d'intelligence artificielle.

| Catégorie | Avantage | Impact |

| Densité de performance | Double Xeon + 8 GPU OAM en 8U | Maximiser la puissance de calcul par unité de baie |

| Extensibilité | 14 emplacements PCIe 5.0, prise en charge OCP 3.0 | Allocation flexible des ressources |

| Facilité d'entretien | Sous-systèmes modulaires interchangeables à chaud | Maintenance sans temps d'arrêt |

| Facilité de gestion | BMC intelligent avec prise en charge Redfish/IPMI | Commande à distance et localisation des pannes |

| Efficacité énergétique | Conception à double plan d'alimentation | Pertes électriques et génération de chaleur réduites |

| Fiabilité | Modules d'alimentation et de ventilation redondants | Disponibilité de niveau professionnel |

Aethlumis offre plus que du matériel — nous fournissons une intégration complète de l'infrastructure IA :

• Conseils en conception et déploiement de cluster

• Optimisation de la topologie réseau

• Planification des ressources GPU et conteneurisation (Kubernetes / Slurm)

• Conception de la distribution thermique et électrique

• Formation à la gestion à distance et support à long terme

Notre équipe d'ingénieurs travaille aux côtés de vos architectes informatiques afin d'optimiser chaque watt, chaque octet et chaque cycle de GPU pour concrétiser vos ambitions en matière d'IA.

Aethlumis collabore avec des partenaires leaders dans les domaines du calcul, du réseau et du stockage, notamment : Intel®, NVIDIA®, Broadcom®, Mellanox® et le Open Compute Project (OAI 2.0).

Cela garantit une compatibilité parfaite et une évolutivité pérenne pour votre investissement.

Aethlumis redéfinit le calcul haute performance — offrant des solutions intelligentes, efficaces et évolutives pour l'ère de l'IA.

Des laboratoires de recherche aux centres de données d'entreprise, nous aidons les organisations à transformer la puissance de calcul en innovation.