Współczesne przedsiębiorstwa i instytucje badawcze zmieniają się w związku z wykładniczym wzrostem danych oraz coraz bardziej złożonymi obciążeniami AI.

• Konwencjonalne systemy serwerowe osiągają swoje granice — mierząc się z:

• Niewystarczającą przepustowością połączeń GPU, co powoduje wąskie gardła podczas treningu

• Niską efektywnością termiczną przy długotrwałych obciążeniach

• Złożonymi cyklami konserwacji i długimi czasami przestojów

• Nielotne ścieżki rozbudowy, które utrudniają skalowanie

Aethlumis eliminuje te bariery dzięki kompleksowemu rozwiązaniu obliczeniowemu, które przekształca tradycyjne centra danych w infrastrukturę AI o wysokiej wydajności.

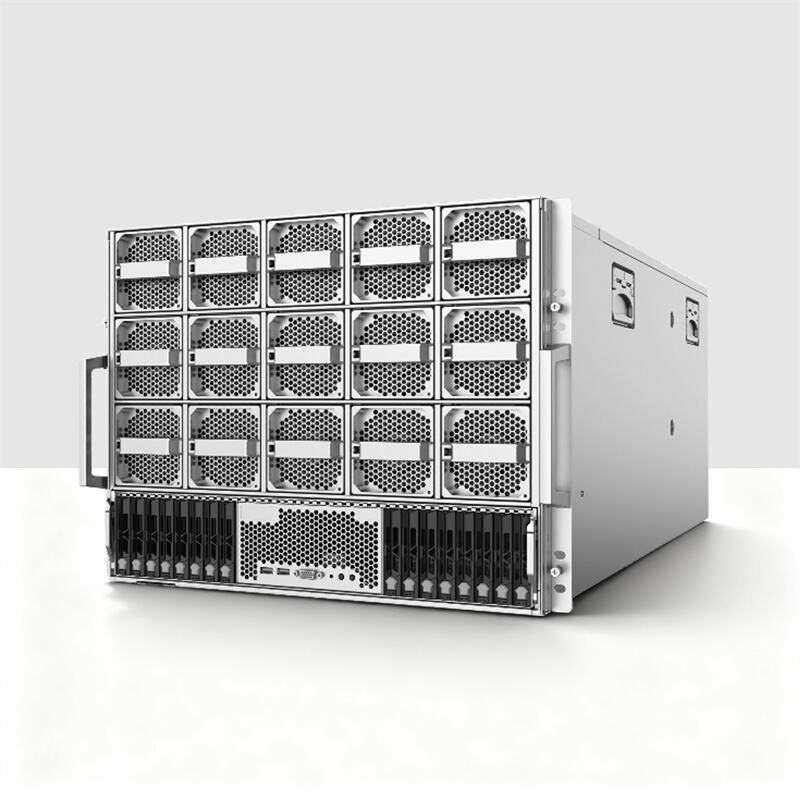

TG990V3 to flagowy serwer AI nowej generacji firmy Aethlumis, zaprojektowany specjalnie do dużoskalowego treningu, wnioskowania i intensywnych obciążeń danych.

Integruje najnowocześniejsze sprzętu, architekturę modułową oraz inteligentne zarządzanie, tworząc rdzeń naszej stosu infrastruktury AI.

Wyróżniki technologiczne

• Moc obliczeniowa: Dwa procesory Intel® Xeon® Scalable 4. i 5. generacji, TDP do 350 W

• Możliwości GPU: Obsługuje do 8 kart GPU typu OAM, pełni połączonych zgodnie ze standardem OAI 2.0

• Elastyczność rozbudowy: Do 14 gniazd PCIe 5.0 + opcjonalny interfejs OCP 3.0

• Wydajność pamięci masowej: Do 20 napędów 2,5″ NVMe / SAS / SATA dla intensywnej operacji wejścia/wyjścia

• Efektywność energetyczna: Konstrukcja podwójnej płaszczyzny (strefa GPU 6 × 54 V + strefa CPU 2 × 12 V) eliminuje straty przetwarzania

• System chłodzenia: 15 wentylatorów z podwójnym wirnikiem z kontrolą strefową, zapewniających stabilną pracę przy pełnym obciążeniu 8 GPU

• Zarządzanie inteligentne: Chip BMC AST2600 obsługujący IPMI 2.0, Redfish i SNMP do pełnego zdalnego monitorowania

Ta podstawa umożliwia zrównoważoną architekturę topologii, obsługując zarówno konfiguracje High-Performance Dual-Uplink, jak i Balanced Single-Uplink, dostosowane do wymagań Twojego klastra obliczeniowego.

Warstwy architektury:

• Warstwa obliczeniowa — Węzły o wysokiej gęstości TG990V3 z 8 GPU typu OAM

• Warstwa sieciowa — 8 × 400 G łącza międzysystemowe zapewniające klastry skalowalne o ekstremalnie niskim opóźnieniu

• Warstwa pamięci masowej — Równoległa pamięć masowa oparta na NVMe dla szybkiego dostępu do danych

• Warstwa zarządzania — Zintegrowana platforma Redfish/IPMI do orkiestracji, telemetrii i izolacji uszkodzeń

Ten modułowy, rozłączony projekt umożliwia niezależne aktualizacje, łatwą konserwację oraz skalowalność poziomą w obrębie szaf lub centrów danych.

Trening modelu AI

Zaprojektowany dla obciążeń na skalę transformatorów, umożliwiających szkolenie modeli o dużej liczbie parametrów przy minimalnej opóźnieniu między GPU.

Obsługuje GPUDirect RDMA i GDS dla wydajnej ścieżki danych pomiędzy GPU a pamięcią masową.

• Inference & Edge AI

Elastyczna konfiguracja GPU umożliwia przyspieszenie wnioskowania w zakresie wizji, NLP lub wielomodalnej sztucznej inteligencji w dużej skali.

Idealny dla usług chmurowych AI i lokalnych wdrożeń brzegowych.

• Centra Obliczeniowe Przedsiębiorstw

Wdróż TG990V3 jako podstawę własnej platformy AI.

Zintegrowane zarządzanie zmniejsza złożoność utrzymania i obsługuje orkiestrację firmware'u, zbieranie dzienników oraz inteligentną diagnostykę.

• Chmury i klastry HPC

Bezproblemowa skalowalność do 400 G dla dużych obliczeniowych struktur — zoptymalizowana pod kątem środowisk wielodostępnych i hybrydowych chmur AI.

| Kategoria | Zalety | Wpływ |

| Gęstość wydajności | Podwójny Xeon + 8 OAM GPU w formacie 8U | Maksymalizacja mocy obliczeniowej na jednostkę racka |

| Skalowalność | 14 gniazd PCIe 5.0, obsługa OCP 3.0 | Elastyczne przydzielanie zasobów |

| Serwisowość | Wymienny na gorąco modułowy podsystem | Serwisowanie bez przestojów |

| Zarządzalność | Inteligentny BMC z obsługą Redfish/IPMI | Zdalna kontrola i lokalizacja uszkodzeń |

| Efektywność energetyczna | Projekt z podwójną płaszczyzną zasilania | Niższe straty mocy i generowanie ciepła |

| Niezawodność | Redundancyjne moduły zasilania i wentylatorów | Dostępność na poziomie enterprise |

Aethlumis oferuje więcej niż tylko sprzęt — dostarczamy pełną integrację infrastruktury AI:

• Konsultacje projektowe i wdrażanie klastrów

• Optymalizacja topologii sieci

• Harmonogramowanie zasobów GPU i konteneryzacja (Kubernetes / Slurm)

• Projektowanie rozdziału ciepła i energii

• Szkolenie z zarządzania zdalnego i długoterminowa obsługa techniczna

Nasz zespół inżynieryjny współpracuje z Twoimi architektami IT, aby zapewnić pełną optymalizację każdego watu, bajta i cyklu GPU pod kątem Twoich ambicji związanych z sztuczną inteligencją.

Aethlumis współpracuje z wiodącymi partnerami ekosystemu w dziedzinie obliczeń, sieci i magazynowania, w tym: Intel®, NVIDIA®, Broadcom®, Mellanox®, oraz Open Compute Project (OAI 2.0).

Gwarantuje to płynną kompatybilność i skalowalność chroniącą inwestycję na przyszłość.

Aethlumis odmienia wydajność obliczeniową — oferując inteligentne, efektywne i skalowalne rozwiązania dla ery sztucznej inteligencji.

Od laboratoriów badawczych po przedsiębiorstwa posiadające centra danych, pomagamy organizacjom zamieniać moc obliczeniową w innowacje.